Die Wissenschaft als Datenlieferant für das gewünschte Narrativ

Es geht bei der Klimadiskussion um enorme politische und finanzielle Folgen. Von Seiten der Alarmisten riskieren wir nichts weniger als die Zukunft unseres Planeten, wenn wir so weitermachen wie bisher. Auf der anderen Seite zerstört Deutschland seine industrielle Basis. Großbritannien riskiert das Leben von Millionen Menschen, indem es Energie und Nahrungsmittel unerschwinglich macht. Arme Länder in Afrika werden von weiterer Entwicklung abgeschnitten. Ohnehin hoch verschuldete Länder riskieren Milliarden, um auf Netto-Null zu setzen und ihre Wettbewerbsfähigkeit auf dem Weltmarkt zu zerstören.

Wenn auf offensichtlich so viel auf dem Spiel steht, sollten wir nicht höchste Ansprüche an die Integrität und Objektivität der Wissenschaft stellen, welche uns in die richtige Richtung führen soll?

Wir kennen die Kriterien, die die Wissenschaft erfüllen muss, um Antworten zu liefern, die der objektiven Realität am nächsten kommen (Popper). Die beiden wichtigsten sind

- Eine Theorie muss falsifizierbar sein, um als wissenschaftliche Theorie zu gelten. Jede Theorie, die nicht widerlegbar ist, ist reine Spekulation.

- Eine Theorie kann nicht als richtig bewiesen werden. Sie ist bestenfalls „noch nicht widerlegt“ und damit möglicherweise wahr. Die zentrale Aufgabe der Wissenschaft ist daher, eine Theorie zu prüfen, ob sie widerlegt werden kann.

Daraus folgt, dass der Versuch eine Theorie wissenschaftlich zu „beweisen“ die Wissenschaft zu einem Werkzeug persönlicher oder politischer Ziele macht.

Wie wir sehen werden, hat die Klimatologie den Bereich der Wissenschaft, in dem Falsifizierbarkeit ein Qualitätskriterium ist, längst verlassen und ist zu einem Versuch geworden, das Narrativ vom menschengemachten Klimawandel zu „beweisen“.

1. Klimamodelle und ihre Rolle bei der „Beweisführung“ für das richtige Narrativ

Fast das gesamte „Verständnis“ des Klimawandels stammt aus Computermodellen. Diese sind extrem komplex (wie auch das Klima laut IPCC). Entsprechend weisen sie einige ernsthafte Probleme auf. Zwar hat sich ein immenses Wissen über die physikalischen Prozesse im Klimasystem angesammelt. Dieses Wissen ist aber bei weitem nicht vollständig. Es gibt zahlreiche und gravierende Lücken.

Zu den vielen Unbekannten gehören Wolken (zu geringe Modellauflösung), der Einfluss von Aerosolen in der Atmosphäre und die Sonneneinstrahlung.

Diese Lücken werden durch Annahmen gefüllt. Natürlich sind diesen Grenzen gesetzt. Sie müssen in einem Bereich liegen, der nicht zu unrealistischen Modellergebnissen führt. Daher werden sie angepasst, um ein Ergebnis zu erhalten, das im Bereich des physikalisch Möglichen liegt. Das ist aber nur die halbe Wahrheit. Diese Annahmen spiegeln immer auch die Interessen des Modellierers wider. Sie können angepasst werden, um ein gewünschtes Ergebnis zu erzielen.

Wir haben oben gesehen, wie stark der politische und finanzielle Druck ist, um die Klimawissenschaft in eine bestimmte Richtung zu lenken. Denken Sie nur an die eine wichtige Annahme, die den gesamten IPCC-Prozess leitet: CO2 muss der Bösewicht sein. Alle anderen Erklärungen für den heutigen Klimawandel müssen entsprechend minimiert oder ausgeschlossen werden.

Eines der besten Beispiele ist die Sonnenstrahlung. Die Bilanz zwischen einfallender kurzwelliger und ausgehender kurz- und langwelliger Strahlung ist der bestimmende Faktor für das Erdklima.  Da es sich um ein Gleichgewicht handelt, könnte man annehmen, dass beide Seiten der Strahlungsgleichung in der Klimatologie die gleiche Aufmerksamkeit (das gleiche Gewicht) erhalten. Das ist aber nicht der Fall. Milliarden werden in den Versuch gesteckt, CO2 als Verursacher nachzuweisen, weil es die langwellige Strahlung absorbiert. Forschung über den Einfluss der einfallenden Sonnenstrahlung auf den Klimawandel (siehe W. Soon oben) ist dagegen nicht populär und, entsprechend, ist das Feld bei weitem nicht ausreichend erforscht. Theorien, die die verfügbaren Daten als Hinweise darauf darstellen, dass (kleine) Änderungen der Sonneneinstrahlung bzw. der auf der Erdoberfläche auftreffenden Strahlung den größten Teil der jüngsten Erwärmung erklären können, werden attackiert, anstatt objektiv und mit ähnlicher Ernsthaftigkeit wie die CO2-Theorie bewertet zu werden. Schließlich muss das IPCC sagen können, dass die langfristige globale Erwärmung nicht allein mit natürlichen Faktoren modelliert werden kann. Und das kann es nur, wenn es die richtigen Annahmen wählt. Entsprechend wird von den bestehenden Theorien, auf deren Grundlage die Sonneneinstrahlung in der Vergangenheit berechnet wird, natürlich diejenige ausgewählt, welche das CO2-Narrativ stützt.

Da es sich um ein Gleichgewicht handelt, könnte man annehmen, dass beide Seiten der Strahlungsgleichung in der Klimatologie die gleiche Aufmerksamkeit (das gleiche Gewicht) erhalten. Das ist aber nicht der Fall. Milliarden werden in den Versuch gesteckt, CO2 als Verursacher nachzuweisen, weil es die langwellige Strahlung absorbiert. Forschung über den Einfluss der einfallenden Sonnenstrahlung auf den Klimawandel (siehe W. Soon oben) ist dagegen nicht populär und, entsprechend, ist das Feld bei weitem nicht ausreichend erforscht. Theorien, die die verfügbaren Daten als Hinweise darauf darstellen, dass (kleine) Änderungen der Sonneneinstrahlung bzw. der auf der Erdoberfläche auftreffenden Strahlung den größten Teil der jüngsten Erwärmung erklären können, werden attackiert, anstatt objektiv und mit ähnlicher Ernsthaftigkeit wie die CO2-Theorie bewertet zu werden. Schließlich muss das IPCC sagen können, dass die langfristige globale Erwärmung nicht allein mit natürlichen Faktoren modelliert werden kann. Und das kann es nur, wenn es die richtigen Annahmen wählt. Entsprechend wird von den bestehenden Theorien, auf deren Grundlage die Sonneneinstrahlung in der Vergangenheit berechnet wird, natürlich diejenige ausgewählt, welche das CO2-Narrativ stützt.

Dabei ist es für jeden offensichtlich, dass sich das Klima schon immer verändert hat – auch bevor die Menschheit CO2 produziert hat. Um dies zu widerlegen, behaupten die Alarmisten einfach, dass der gegenwärtige Wandel „beispiellos“ sei. Sie untermauern diese Behauptung, indem sie den Zeitrahmen und die Proxies (Materialien, die den Temperaturverlauf der Vergangenheit abbilden, z. Bsp Jahresringe im Bäumen) so wählen, dass sie die gewünschten Ergebnisse liefern. Die bekannteste Darstellung dieser Behauptung ist die Hockeystick-Kurve von M. Mann – bekannt aus den Climategate-E-Mails.  Dieses Darstellung ist stark in Frage gestellt worden. Dennoch ist das Interesse an einer beispiellosen Erwärmung in den letzten Jahrzehnten sehr groß. Eine Möglichkeit, dies zu erreichen, besteht darin, die tatsächlichen Temperaturmessungen zu manipulieren (siehe unten). Eine andere Möglichkeit besteht darin, die Temperatur-Proxies so auszuwählen, dass sie das gewünschte Narrativ bestätigen. Offensichtlich ist die Idee der „Falsifizierung“ in der Klimawissenschaft längst ad acta gelegt.

Dieses Darstellung ist stark in Frage gestellt worden. Dennoch ist das Interesse an einer beispiellosen Erwärmung in den letzten Jahrzehnten sehr groß. Eine Möglichkeit, dies zu erreichen, besteht darin, die tatsächlichen Temperaturmessungen zu manipulieren (siehe unten). Eine andere Möglichkeit besteht darin, die Temperatur-Proxies so auszuwählen, dass sie das gewünschte Narrativ bestätigen. Offensichtlich ist die Idee der „Falsifizierung“ in der Klimawissenschaft längst ad acta gelegt.

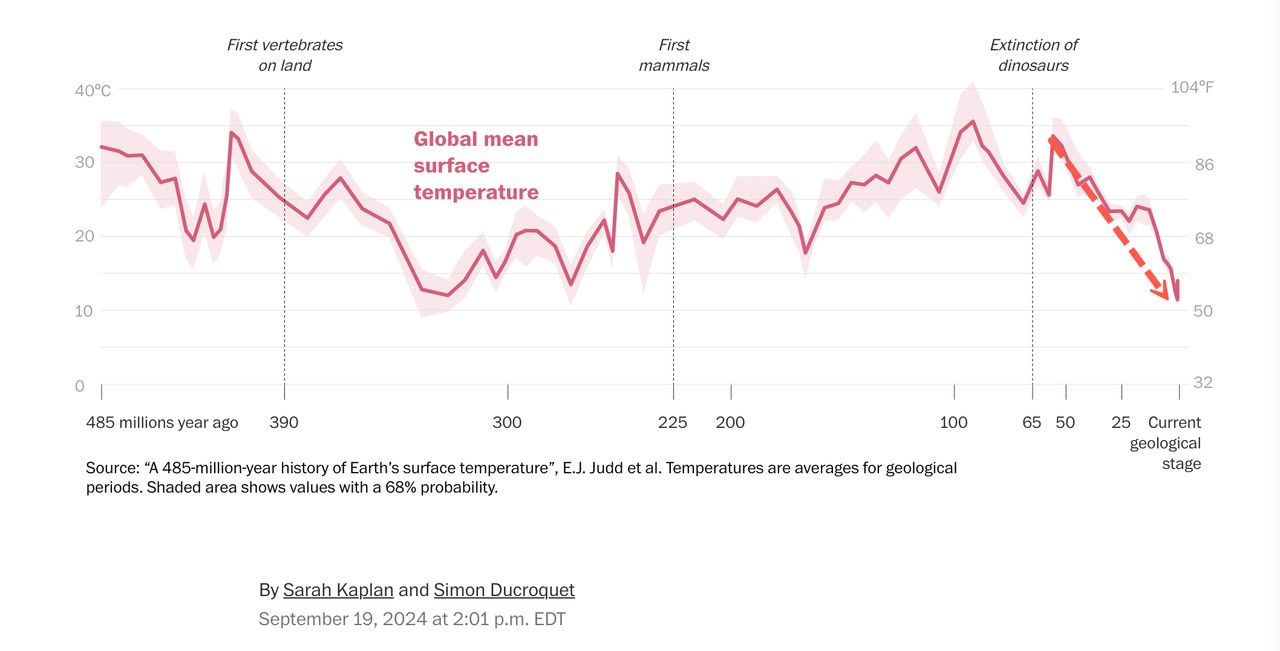

Eine bemerkenswerte Sammlung von 600 Publikationen, die die Hockeystick-Theorie widerlegen, findet sich in der notrickszone.  Auch die Washington Post hat versehentlich Daten veröffentlicht, die das „beispiellos“ stark relativieren: die letzten Million Jahre waren im Durchschnitt die kältesten der jüngeren Erdgeschichte.

Auch die Washington Post hat versehentlich Daten veröffentlicht, die das „beispiellos“ stark relativieren: die letzten Million Jahre waren im Durchschnitt die kältesten der jüngeren Erdgeschichte.

Abgesehen von der offensichtlichen Voreingenommenheit bei der Auswahl der Annahmen, gibt es noch ein weiteres Problem. Da die Annahmen Unsicherheiten in die Modelle einbringen, ist es von großer Bedeutung, wie die Modelle mit diesen Unsicherheiten umgehen. Der Grund dafür ist, dass die Modelle eine immense Anzahl von iterativen Berechnungen durchführen, wobei jeder Schritt vom Ergebnis des vorherigen abhängt. Es ist leicht einzusehen, dass sich Fehler fortpflanzen können, was ein großes Problem für die Zuverlässigkeit der Modellprognosen darstellt.

Darüber hinaus können die sehr komplexen Modelle sehr unterschiedliche Ergebnisse liefern, beginnend mit sehr kleinen Unterschieden in den Anfangsbedingungen (Schmetterlingseffekt aus der Chaostheorie). Dieses Problem versuchen die Klimaforscher durch den Einsatz von Modellensembles zu lösen. Dabei gibt es jedoch einige Probleme. Bei der Verwendung von Ensembles wollen uns die Klimaforscher glauben machen, dass die Präzision des Modellierungsprozesses (wie gut die Resultate der verschiedenen Modelle miteinander übereinstimmen) etwas über die Genauigkeit der Modelle aussagt (wie gut sie die Realität abbilden). Wenn jedoch die Fehler, die durch falsche Annahmen verursacht werden, systematisch (und nicht zufällig) sind, trägt das Ensemble in keiner Weise dazu bei, die Modelle der Realität anzunähern. Darüber hinaus ist es absolut sicher, dass die Modelle die Realität der Prozesse in der Erdatmosphäre nicht perfekt widerspiegeln. E. Thompson hat aber gezeigt, wie schon kleine Unzulänglichkeiten in der mathematischen Struktur der Modelle die Wahrscheinlichkeitsvorhersagen völlig unzuverlässig machen.

2. Testen der Modelle auf ihre Prognosefähigkeit

Es gibt also gute Gründe, den Modellierern und ihren Modellen nicht zu trauen. Glücklicherweise können Modelle getestet werden, um ihre Zuverlässigkeit besser beurteilen zu können.

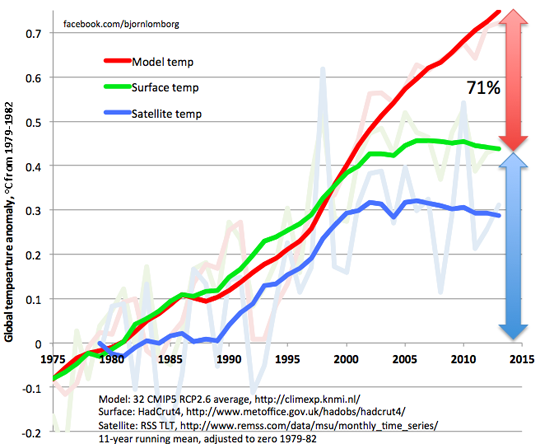

Der Standardtest für ein Modell ist der Vergleich seiner Ergebnisse mit Daten aus der realen Welt. Dies war von Anfang an eine Herausforderung, da die Modelle so weit in die Zukunft blicken. Ein typischer alternativer Ansatz zur Lösung dieses Problems ist das Hindcasting (Modellierung der Vergangenheit). Die Modelle (resp. die enthaltenen Annahmen) werden so lange angepasst, bis die Temperaturen der Vergangenheit korrekt modelliert (hindcasted) werden. Man geht davon aus, dass dies ein guter Test für ihre Fähigkeit ist, zukünftige Temperaturen vorherzusagen. Es gibt jedoch ein großes Problem. Da sich die diversen Modelle in ihrer Klimasensitivität um bis zu einem Faktor drei unterscheiden, bedeutet ein korrektes Hindcasting lediglich, dass die Variablen für diesen Zeitraum entsprechend angepasst wurden. Über ihre Prognosefähigkeit sagt das nichts aus.  Dies zeigt die Grafik der globalen bodennahen Lufttemperatur.

Dies zeigt die Grafik der globalen bodennahen Lufttemperatur.

Die Anpassung der Annahmen, um die Temperatur von 1979 bis 1995 zu reproduzieren (Kurven stimmen gut überein), führt für die Zeit danach nicht zu einer genauen Vorhersage (Kurven gehen immer weiter auseinander).

Da wir glücklicherweise die Vorhersagen der Modelle über die letzten 40 Jahre kennen, haben wir eine ganze Reihe von Datenpunkten, mit denen wir deren Vorhersagefähigkeit überprüfen können. Dabei ist jedoch zu beachten, dass die Modellannahmen ständig aktualisiert werden, um sie an die neuesten Messwerte anzupassen. Das bedeutet, dass wir auf ältere Modelle und ihre Vorhersagen zurückblicken müssen, um ihre Gültigkeit zu beurteilen. Wenn wir das tun, sind die Ergebnisse ziemlich enttäuschend.

Im ersten Sachstandsbericht (FAR) des IPCC von 1990 heißt es: Unter den IPCC-Emissionsszenarien „Business as usual“ (Szenario A) steigt die globale Durchschnittstemperatur im nächsten Jahrhundert um etwa 0,3 °C pro Jahrzehnt (mit einer Unsicherheit von 0,2 °C bis 0,5 °C pro Jahrzehnt) Dies führt bis 2025 zu einem wahrscheinlichen Anstieg der globalen Durchschnittstemperatur um etwa 1 °C gegenüber dem heutigen Niveau.

Was wir bisher erlebt haben, ist ein durchschnittlicher Anstieg von etwa 0,18 °C pro Jahrzehnt.

Das ist etwas mehr als die Hälfte der vorhergesagten Erwärmung. Betrachtet man nur den Zeitraum seit 1990, könnte die Erwärmung sogar noch geringer ausfallen. (Wir werden später sehen, dass die hier genannten gemessenen Temperaturanstiege zudem eher zu hoch sind, weil sie – wieder einmal – auf „passenden“ Annahmen beruhen.)

Das Problem scheint sich mit der Zeit nicht gebessert zu haben, wie selbst das IPCC zugeben musste:

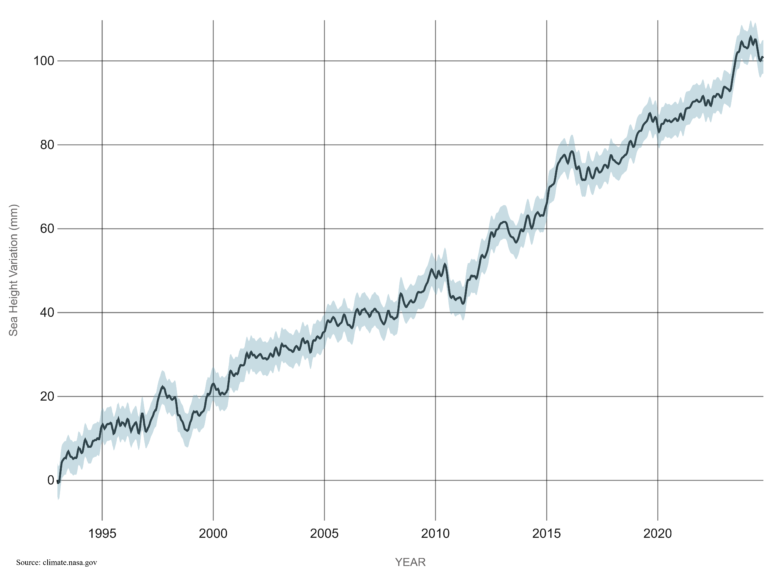

Ebenfalls im FAR finden wir einen prognostizierten globalen Meeresspiegelanstieg von etwa 6 cm pro Jahrzehnt im nächsten Jahrhundert … Der prognostizierte globale Meeresspiegelanstieg bis 2030 beträgt etwa 20 cm.

Was sagen uns die aktuellen Daten?  Die Messungen der NASA zeigen einen Meeresspiegelanstieg von etwa 3,3 cm pro Jahrzehnt zwischen 1993 und 2023. Auch dieser Wert liegt gegen 50% unter den Vorhersagen.

Die Messungen der NASA zeigen einen Meeresspiegelanstieg von etwa 3,3 cm pro Jahrzehnt zwischen 1993 und 2023. Auch dieser Wert liegt gegen 50% unter den Vorhersagen.

Das Testen der Modelle von 1990 deutet also darauf hin, dass sie die globale Erwärmung und ihre Auswirkungen um fast 100 % überschätzten.

Sind spätere Modelle besser? Das obige Zitat aus dem AR6 deutet darauf hin, dass dies wahrscheinlich nicht der Fall ist. Das wäre nicht verwunderlich, da sie immer noch versuchen, CO2 als Hauptverursacher zu beweisen.

Eine weitere Grafik untermauert diesen Punkt und weist auf ein weiteres Problem hin, das in dieser Diskussion auftaucht: die Unterschiede zwischen Vorhersagen, Messungen an Land und Satellitendaten (s. unten).

3. „Beweise“, dass die Modelle mit ihren Vorhersagen richtig liegen, sind reines Gaslighting

Natürlich werden die Alarmisten solche Daten nie widerstandslos hinnehmen. Für sie steht zu viel auf dem Spiel. Hier ist ein Beispiel dafür. Es bestätigt meine These, dass es den Klimawissenschaftlern nicht darum geht, uns die Wahrheit zu sagen, sondern darum, das Narrativ zu stützen.

In ihrer Veröffentlichung behaupten Hausfather et al, dass die Modellvorhersagen gut mit den gemessenen Temperaturen übereinstimmen. Sie verwenden einen raffinierten Trick, um das eigentliche Problem mit den Temperaturvorhersagen und der daraus resultierenden Panikmache zu verschleiern.

Er geht so: Alle Modelle laufen mit unterschiedlichen Emissionsszenarien (SSP) und zeigen die entsprechenden Temperaturprognosen.

Von diesen Emissionsszenarien beziehen sich alle IPCC-Zusammenfassungen und fast alle öffentlichen Äußerungen von Klimawissenschaftlern in den Medien auf Vorhersagen, welche auf dem schlimmsten, dem 8.5-Szenario (SSP 585 in der Grafik) basieren. Um Glaubwürdigkeit vorzutäuschen, bezeichen sie dann dieses extrem unwahrscheiliche Scenario als „business as usual“. Alle alarmierenden Vorhersagen über Hitzewellen, extremes Wetter, Anstieg des Meeresspiegels usw. basieren darauf. All die Billionen, die ausgegeben werden, um eine gefährliche globale Erwärmung zu verhindern, sind mit diesem Szenario verknüpft. Und wie gezeigt wurde (siehe Beispiele oben), sind die CO2-Prognosen, die auf diesem Szenario basieren, eindeutig zu hoch.

Anstatt dies anzuerkennen und ihre Forschungsgelder zu riskieren, ersetzen Hausfather et al. in ihrer Veröffentlichung einfach das 8.5-Szenario in den Modellrechnungen durch ein Szenario, das von geringeren CO2-Emissionen ausgeht, und behaupten, die angepassten Ergebnisse seien ein Beweis dafür, dass die Modelle nicht zu heiss laufen.

Wird also Alarm geschlagen um mehr Geld und Macht zu erhalten, werden in allen Verlautbarungen die Modellergebnisse des 8.5-Szenarios verwendet. Wenn die hohen Temperaturvorhersagen, die auf diesen hohen Emissionen basieren, als übertrieben nachgewiesen werden (und als Alarmismus entlarvt), benützt die Klimatologie zur Argumentation einfach die Modellergebnisse bei niedrigeren Emissionsdaten. Und behauptet dann, die Genauigkeit der Vorhersagen sei bewiesen.

Die unterstützenden Schlagzeilen der Medien sind ihnen sicher: Die Leugner lügen und manipulieren die Daten, die Modelle funktionieren gut, vertraut der Wissenschaft. Ein besseres Beispiel für Gaslighting, rsp. Irreführung der Öffentlichkeit, kann es kaum geben.

4. Datenauswahl und -manipulation

Es gibt noch viele andere Methoden, mit denen Alarmisten versuchen, die Unterschiede zwischen Vorhersagen und Messungen nicht allzu offensichtlich werden zu lassen. Einer der wichtigsten Kritiker der Modellvorhersagen ist Roy Spencer. Er ist der führende Wissenschaftler, welcher mit dem NASA-Satelliten Aqua zur Temperaturüberwachung arbeitet. Wie oben zu sehen ist, zeigen seine Satelliten- (und Ballon-) Daten tendenziell eine geringere Erwärmung als die Messungen an der Erdoberfläche und deutlich weniger als die Vorhersagen, die auf dem 8.5-Szenario basieren. Das ruft natürlich die Alarmisten auf den Plan, die eine möglichst hohe Erwärmung fordern. Sie argumentieren mit den Unsicherheiten der Satellitenmessungen (die aber auch nach weiteren Korrekturen immer noch eine geringere Erwärmung zeigen) und behaupten, dass wir uns auf die „viel zuverlässigeren“ Oberflächendaten (die näher an den Modellvorhersagen liegen) verlassen müssen. Das Problem ist jedoch, dass die Oberflächendaten noch weniger zuverlässig sind.

Ein großes Problem ist, dass sich die Bodenmessstationen selbst oder ihre Umgebung im Laufe der Zeit verändern. Stationen werden ersetzt oder verlegt. Die Oberfläche um die Stationen herum kann gepflastert werden, neue Gebäude werden errichtet, Wärmequellen können näher rücken. Die Klimatologie begegnet diesem Problem, indem sie die Daten homogenisiert. Das bedeutet nicht, dass die Geschichte jeder einzelnen Station überprüft und die beobachteten Veränderungen korrigiert werden. Die Homogenisierung geschieht mit Hilfe eines Computerprogramms namens „Pairwise Homogenization Algorithm“ (PHA). Im Wesentlichen vergleicht es jede Station mit ihren Nachbarstationen und prüft, ob ihr Trend parallel zu dem der Nachbarstationen verläuft. Stellt der Algorithmus eine plötzliche Veränderung an einer Station im Vergleich zu den anderen fest, so wird diese Diskontinuität (auch „Bruchstelle“ genannt) als Beweis dafür gewertet, dass sich an der Station etwas verändert hat. Die Messwerte der „fehlerhaften“ Station werden dann angepasst. Dieser Homogenisierungsprozess wird wiederholt durchgeführt, in manchen Fällen sogar täglich. Es hat sich jedoch gezeigt, dass der Algorithmus bei der Identifizierung von Bruchstellen sehr inkonsistent ist und dass die von ihm identifizierten Bruchstellen meist nichts mit tatsächlichen Veränderungen in der Umgebung einer Station zu tun haben. Wir können davon ausgehen, dass auch hier die Klimatologen die Variablen in den Algorithmen so setzen, dass sie ihre Geschichte stützen.

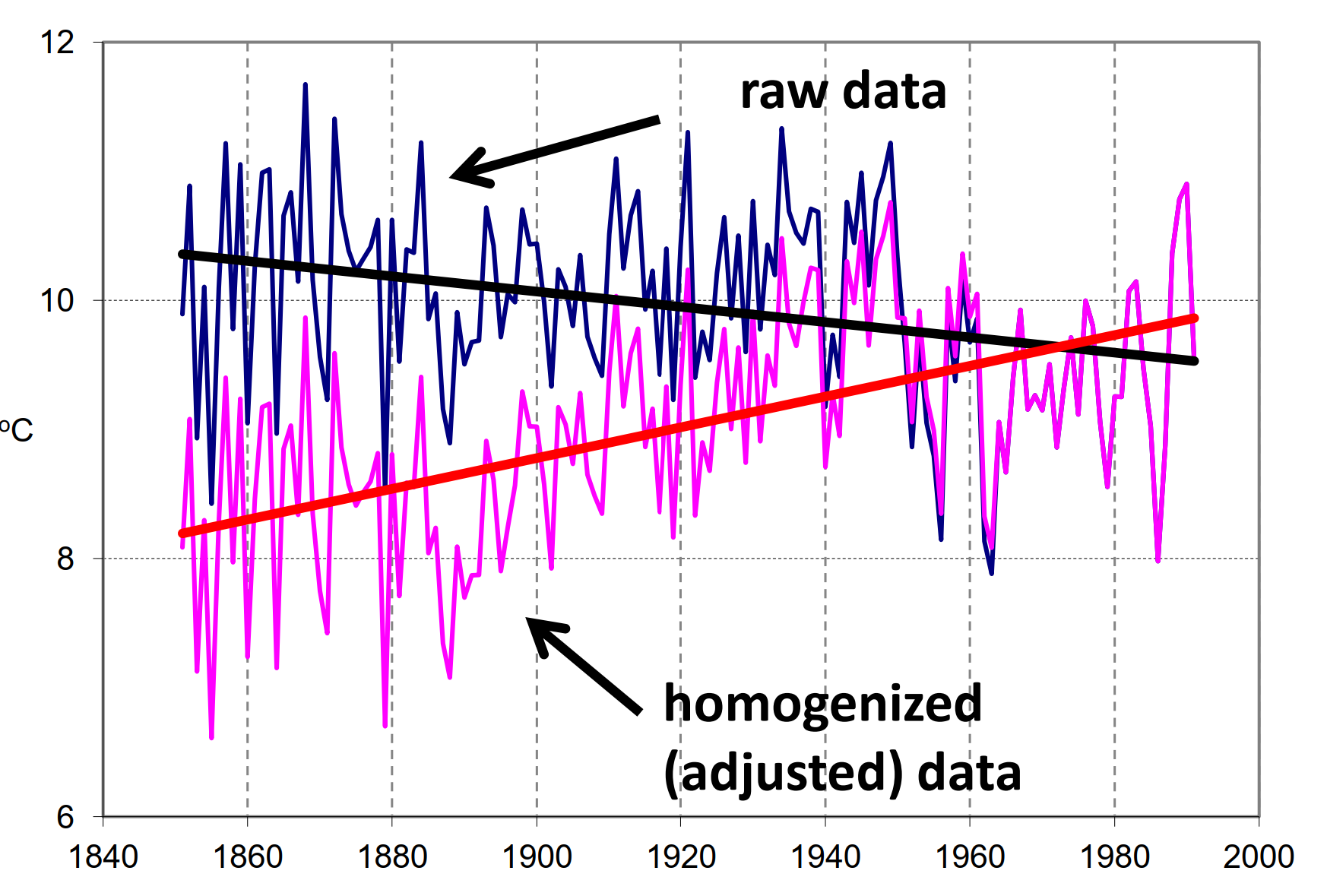

Dies lässt sich leicht erkennen, wenn man die Korrekturen der vergangenen Temperaturen betrachtet, die diese Homogenisierungen erzeugen. Sie erhöhen in den meisten Fällen die Erwärmungsrate. Hier einige Beispiele (und Links zu weiteren):

Die linke Grafik zeigt die Temperaturdaten des amerikanischen Kontinents vor (orange) und nach (blau) der Homogenisierung. Ergebnis: eine Verstärkung des Erwärmungstrends.

Die linke Grafik zeigt die Temperaturdaten des amerikanischen Kontinents vor (orange) und nach (blau) der Homogenisierung. Ergebnis: eine Verstärkung des Erwärmungstrends.

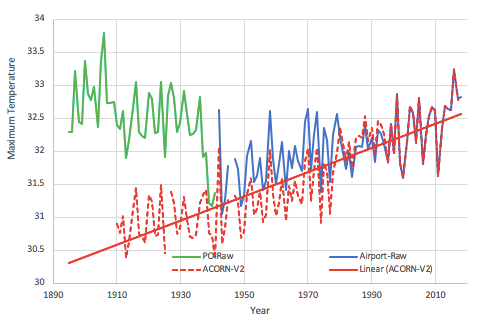

Mittlere Jahreshöchsttemperaturen gemessen am Postamt und Flughafen von Darwin (grün/blau) und nach der Homogenisierung (rot) in den neuen offiziellen Aufzeichnungen für Australien.

Die Homogenisierung der globalen Temperaturen im Diagramm des GISS (NASA Goddard Institute for Space Studies) zeigt überwiegend Korrekturen nach unten (blau) in der ferneren Vergangenheit und mehr Korrekturen nach oben (rot) in den letzten 40 Jahren. Das Ergebnis: ein stärkerer Erwärmungstrend.

Die Homogenisierung der globalen Temperaturen im Diagramm des GISS (NASA Goddard Institute for Space Studies) zeigt überwiegend Korrekturen nach unten (blau) in der ferneren Vergangenheit und mehr Korrekturen nach oben (rot) in den letzten 40 Jahren. Das Ergebnis: ein stärkerer Erwärmungstrend.

Station De Bilt – Niederlande Quelle: Datenbank GHCN-Monthly Version 2.Zeigt deutlich höheren Erwärmungstrend nach Homogenisierung

Es gibt viele Beispiele, die die gleiche Verzerrung zeigen. Hier einige wenige:

Änderungen der US-Temperaturrekorde, NOAA-Datenmanipulation, Tobs at ithaca, Temperaturen im Central Park, Temperaturdaten von 100 nicht existierenden Stationen.

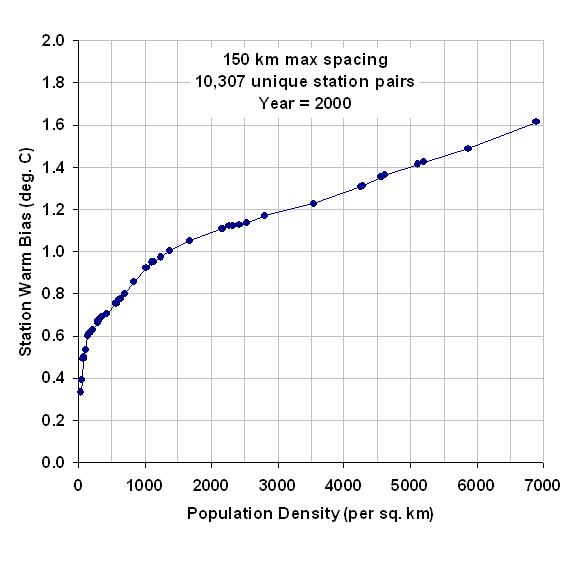

Eine weitere große Herausforderung für landgestützte Daten ist der städtische Wärmeinseleffekt (UHI). Das bedeutet, dass Wetterstationen in der Nähe von bebauten Gebieten höhere Temperaturen messen, weil menschliche Aktivitäten Wärme erzeugen und weil sich Gebäude und Straßenbeläge in der Sonne stärker und schneller aufheizen.

Eine weitere große Herausforderung für landgestützte Daten ist der städtische Wärmeinseleffekt (UHI). Das bedeutet, dass Wetterstationen in der Nähe von bebauten Gebieten höhere Temperaturen messen, weil menschliche Aktivitäten Wärme erzeugen und weil sich Gebäude und Straßenbeläge in der Sonne stärker und schneller aufheizen.

Die Klimawissenschaftler behaupten, dass sie den UHI-Effekt aus den Temperaturaufzeichnungen herausrechnen können, indem sie ländliche und städtische Stationen homogenisieren. Allerdings führen sie ihre Berechnungen auf der Grundlage von ihnen genehmen Annahmen durch anstatt die tatsächlichen Daten der Stationen zu berücksichtigen. Infolgedessen lassen sie einen wichtigen Faktor außer Acht, der mit dem Standort der Stationen zusammenhängt:

Ländliche Stationen sind keineswegs frei von Verstädterungseffekten. Das Gegenteil ist der Fall. Der Urbanisierungseffekt ist bei geringer Bevölkerungsdichte am größten. Das Hinzufügen einiger Gebäude zu wenigen bereits über ein bestimmtes Gebiet verteilten Gebäuden hat einen viel größeren relativen Effekt als das Hinzufügen der gleichen Anzahl von Gebäuden zu Hunderten in einem gleich großen Gebiet in einer Stadt. Die Grafik verdeutlicht dies.

Ländliche Stationen sind keineswegs frei von Verstädterungseffekten. Das Gegenteil ist der Fall. Der Urbanisierungseffekt ist bei geringer Bevölkerungsdichte am größten. Das Hinzufügen einiger Gebäude zu wenigen bereits über ein bestimmtes Gebiet verteilten Gebäuden hat einen viel größeren relativen Effekt als das Hinzufügen der gleichen Anzahl von Gebäuden zu Hunderten in einem gleich großen Gebiet in einer Stadt. Die Grafik verdeutlicht dies.

Die Tatsache, dass die Wetterstationen in völlig unberührten Gebieten in den USA einen viel geringeren Erwärmungstrend aufweisen als die homogenisierten Werte der NOAA (National Oceanic and Atmospheric Administration) für das gesamte Gebiet, zeigt deutlich, dass der Algorithmus einen großen Teil dieses UHI-Effekts übersieht.

Die Oberflächen-Alterung der Wetterstationen ist eine weitere Herausforderung für die Anpassung durch den Homogenisierungs-Algorithmus. Sie erhöht nämlich langsam den Erwärmungstrend, bis die Alterung durch einen neuen Anstrich oder Austausch rückgängig gemacht wird (was eine Diskontinuität darstellt und zu einer fehlerhaften Homogenisierung führt).

Außerdem waren bis vor kurzem >80 % der Erdoberfläche nicht mit Stationen abgedeckt, und die verbleibenden Stationen waren sehr ungleichmäßig verteilt. Zudem hat sich die Abdeckung im Laufe der Zeit verändert (z.B. nach dem Zusammenbruch der Sowjetunion). Diese Tatsachen ermöglichen es den Forschern, die Temperaturänderungen für einen großen Teil der Fläche für einen großen Teil der Zeit abzuschätzen/zu berechnen. Da wir die starken Motive der Wissenschaftler kennen, die CO2-Theorie zu beweisen, können wir davon ausgehen, dass sie auch hier ihre Schätzungen entsprechend auswählen.

Zusammenfassend gibt es mehr als genug Gründe, den oberflächenbasierten Temperaturaufzeichnungen nicht zu trauen. Sie sind eindeutig in einer Weise „homogenisiert“, die den Erwärmungstrend überschätzt. Die niedrigeren Werte der Satellitenmessungen scheinen der Realität näher zu kommen. Dies bestätigt, dass die Modelle die Erwärmung übertreiben, um das gewünschte Narrativ zu untermauern.

5. Sind die komplexen Modelle vielleicht überhaupt ein grosses TAMTAM, um eine banale Wahrheit zu verbergen?

Mindestens zwei Wissenschaftler haben unabhängig voneinander demonstriert, dass die Ergebnisse der immens komplexen Klimamodelle durch eine einfache Gleichung reproduziert werden können. Sie zeigten, dass deren Ergebnisse mit denen einer linearen Gleichung (Beispiel 1) übereinstimmen, die die Temperaturänderung mit der Änderung des berechneten Einflussfaktors (forcing) (Beispiel 2) verknüpft. Mit anderen Worten: Die aufwendige Rechnerei soll einfach verbergen, dass die Modelle solange optimiert wurden, bis sie CO2 als einzige Einflussgrösse bei der Erwärmung ausspucken – genau wie es das Narrativ verlangt.

Das Forcing stellt die Einflüsse auf die Energiebilanz der Erde dar:

Einfallende Strahlungsenergie der Sonne – ausgehende Strahlungsenergie = Strahlungforcing, berechnet auf der Basis von Annahmen über den Einfluss von Sonnenstahlungsänderungen, Treibhausgasen, Reflexionen an Aerosolen etc.

Beispiel 1

Beispiel 1

Gelb: Ergebnisse des GISS-Modells, blau: Ergebnisse der einfachen linearen Gleichung, die die Temperaturänderung direkt mit der Änderung des Forcings verknüpft.

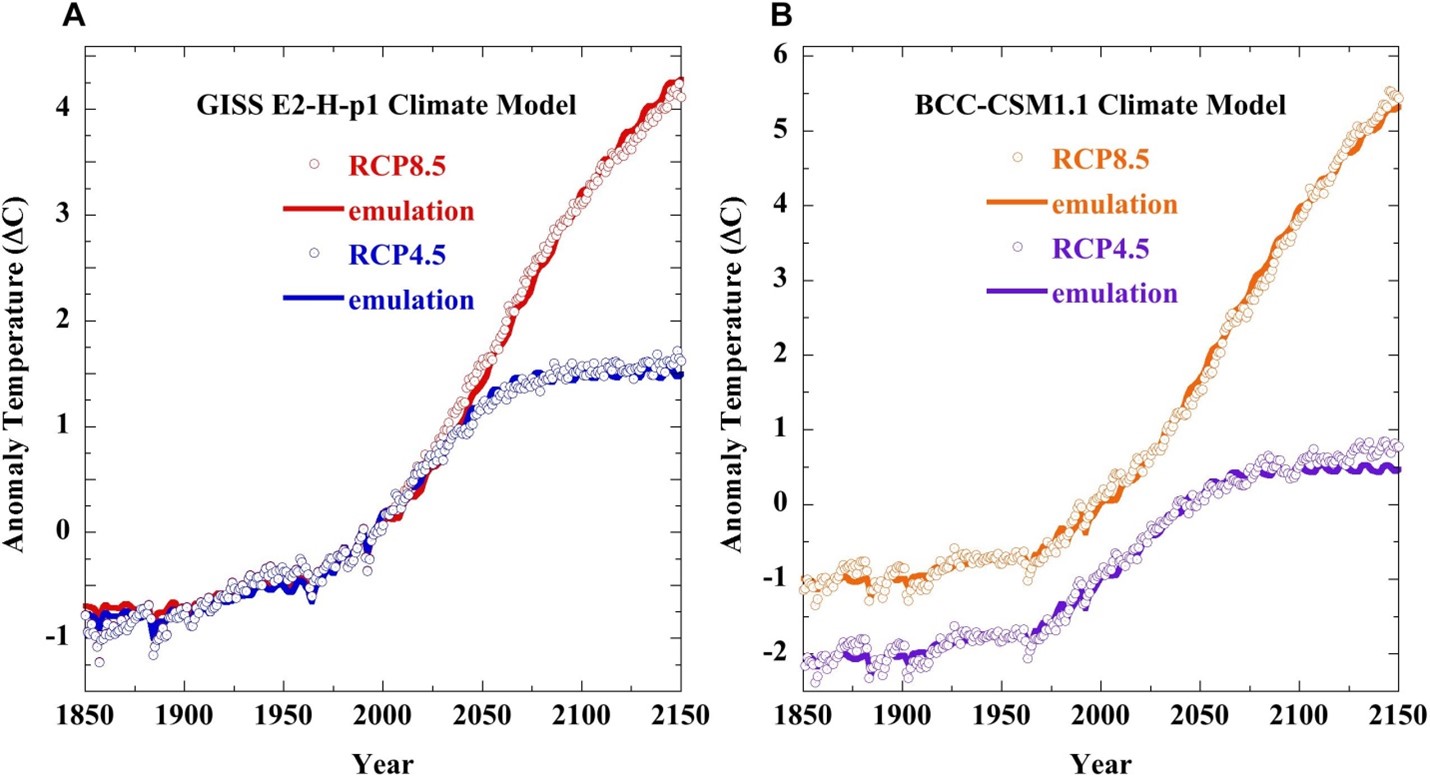

Beispiel 2

Die durchgezogenen Linien sind die Ergebnisse des GISS-Modells und die Kreise stellen die Resultate der einfachen Berechnungen dar, die die Temperaturänderungen mit den Änderungen des Forcing verknüpfen.

Die durchgezogenen Linien sind die Ergebnisse des GISS-Modells und die Kreise stellen die Resultate der einfachen Berechnungen dar, die die Temperaturänderungen mit den Änderungen des Forcing verknüpfen.

Ist das nicht der endgültige Beweis? All die Milliarden, die für die Modelle ausgegeben wurden, und alles, was sie produzieren, sind Kurven, die einfach die Temperatur mit dem berechneten Forcing in Beziehung setzen, genau so, wie sie es müssen, wenn sie beweisen wollen, dass CO2 der Bösewicht ist.

Und dann: Mit dieser einfachen Nachbildung der überkomplexen Modelle berechnet ein Autor eine Klimasensitivität (Temperaturanstieg bei Verdoppelung des CO2-Gehalts in der Atmosphäre) von 1.1 – weit entfernt von den dramatischen 3 bis 4, mit denen uns die Alarmisten seit 40 Jahren erschrecken.

Summary

Zusammenfassend kann man sagen, dass die Klimatologie zwei Wege gefunden hat, um die „richtigen“ Ergebnisse ihrer „Forschung“ sicherzustellen.

Sie unterdrückt Daten, die nicht zu ihren Ergebnissen passen, indem sie die Wissenschaftler, die zu diesen Ergebnissen kommen, diskreditiert oder indem sie deren Ergebnisse in den IPCC-Berichten einfach ignoriert.

Aus den vielen Hypothesen, die notwendig sind, um die Lücken in unserem Verständnis der Klimaprozesse zu schließen, wählt sie diejenigen aus, die zum gewünschten Ergebnis führen: CO2 ist es und sonst nichts.

Kann uns diese Art von „Wissenschaft“ die Instrumente an die Hand geben, um die Auswirkungen unseres Lebensstils auf das Klima objektiv zu beurteilen? Mit Sicherheit nicht. Sie ist eher Voodoo als das, was Popper von der Wissenschaft verlangte, um ernst genommen zu werden.

Aber offensichtlich sind die Interessen zu mächtig, um die Klimapanik aufrechtzuerhalten. Die nicht gewählten Bürokraten der UNO und der EU sehen ihre Macht immens wachsen. Die US-Regierung unter J. Biden kann Milliarden für ihre Lieblingsthemen ausgeben. Grüne NGOs sehen ihren Einfluss und ihren Geldzufluss zunehmen. Die Medien können ihre Kunden mit einem endlosen Kreislauf von Bedrohungsszenarien und Weltuntergangspropaganda an die Bildschirme fesseln. Und nicht zuletzt garantieren die Billionen, die für „Net Zero“ ausgegeben werden, den Großinvestoren in „grüne“ Energien und in den Neustart unserer Gesellschaften enorme Renditen.

Am Ende werden einige Wenige durch Subventionen und Korruption VIEL reicher und die Armen dieser Welt können ihre Hoffnung auf ein menschenwürdigen Leben durch billige Energie vergessen. Wie lange wollen wir uns das noch mitmachen?